- A programação envolve muito mais leitura, navegação em código e superação de barreiras cognitivas do que apenas escrever linhas de código.

- A maior parte do custo de um sistema ao longo da vida está na manutenção: corrigir, adaptar e melhorar o software existente.

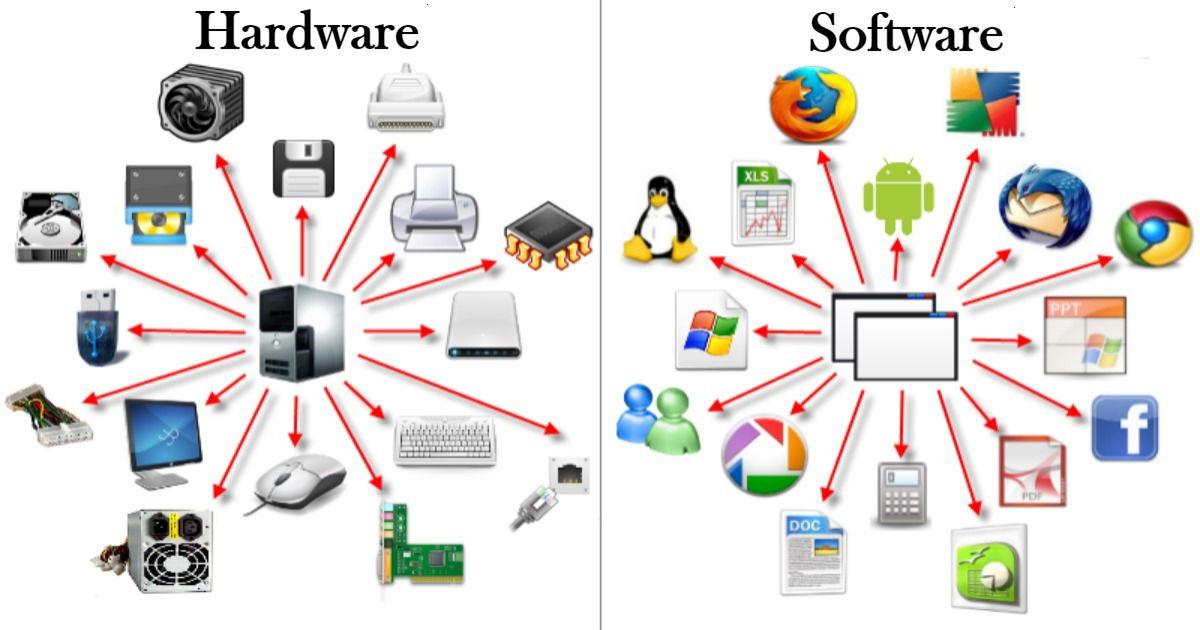

- Hardware e software cumprem papéis distintos, mas interdependentes, e ambos exigem camadas específicas de segurança.

- A segurança informática combina proteção de hardware, software e redes para mitigar ameaças crescentes num mundo hiperconectado.

A programação, o software e os programas informáticos estão tão enraizados no nosso dia a dia que muitas vezes nem percebemos o quanto dependemos deles: do telemóvel ao micro-ondas, do banco online aos jogos, tudo passa por código. Por trás de cada aplicação “simples” há uma combinação de teoria, experimentos, falhas, correções e muita criatividade.

Ao mesmo tempo, a segurança digital, o hardware e a forma como mantemos e evoluímos o software são temas muito mais complexos do que aparentam. Existem dados curiosos sobre o que os programadores realmente fazem no dia a dia, porque certos erros são tão comuns, quanto custa manter um sistema no ar e como diferentes tipos de segurança tentam proteger tudo isso. Neste artigo, vamos juntar essas curiosidades e organizar esse mundo de informações de forma clara e bem completa.

Curiosidades históricas e culturais sobre programação

Uma das curiosidades mais famosas da história da programação é que o primeiro algoritmo pensado para ser executado por uma máquina foi escrito por uma mulher: Ada Lovelace, em meados do século XIX, para a Máquina Analítica de Charles Babbage. Muito antes dos computadores modernos existirem, ela já descrevia como instruções formais poderiam ser processadas por uma máquina, o que a tornou um ícone da computação.

Hoje, o ecossistema de linguagens de programação é gigantesco: existem mais de 700 linguagens documentadas, desde veteranas como C, C++ e Java até linguagens mais recentes como Swift ou Kotlin, passando por favoritas da comunidade, como Python e JavaScript. Cada linguagem nasce com um objetivo específico (desenvolvimento web, sistemas embarcados, ciência de dados, jogos, etc.), embora muitas acabem usadas em cenários bem diferentes dos originais.

Quase todo mundo que começa a programar passa pelo famoso programa “Hello, World!”. É um miniprograma que simplesmente escreve a frase na tela, mas serve como ritual de iniciação: confirma se o ambiente está configurado, se o compilador ou interpretador funciona e introduz a sintaxe básica da linguagem. Simples, mas simbólico.

Outra curiosidade clássica é a origem do termo “bug” para designar erro em software. Em 1947, um inseto real ficou preso num relé do computador Mark II, causando mau funcionamento. Os engenheiros registraram aquilo como um “bug” (bicho, em inglês), e o termo pegou. Hoje, “debugar” é justamente o ato de encontrar e corrigir esses erros.

A relação entre programação e grandes feitos históricos também rende boas histórias. O código que guiou a missão Apollo 11, que levou humanos à Lua, foi escrito com recursos incrivelmente limitados se comparados aos de hoje. Em 2016, a NASA disponibilizou esse código no GitHub, permitindo que qualquer pessoa veja como o software era estruturado, comentado e otimizado para um hardware extremamente restrito.

Mesmo antes das linguagens modernas, já existiam formas primitivas de “programação”. O código Morse, por exemplo, pode ser visto como uma linguagem binária rudimentar, baseada em pontos e traços (sinais curtos e longos) — uma espécie de antecessor conceitual do que hoje entendemos como codificação binária.

Dentro da cultura dos programadores, algumas convenções curiosas também se tornaram padrão, como o uso de CamelCase em nomes de variáveis e funções (por exemplo, minhaVariavelDeExemplo), em que cada nova palavra começa com maiúscula. Isso facilita a leitura do código, principalmente em projetos grandes.

Até o spam, aquele e-mail chato que todos detestam, tem raízes ligadas a programadores. Em 1978, dois técnicos enviaram a primeira mensagem de spam através da ARPANET, a rede que antecedeu a internet, para promover um sistema DEC. Ninguém imaginava que aquilo seria o embrião de um problema gigantesco de comunicação digital.

No fim das contas, tudo o que os computadores fazem é manipular sequências de 0 e 1. A base de todos os programas é o código binário: cada instrução, número, cor, som e vídeo é representado por cadeias de bits que o processador entende, transformando operações lógicas em funcionalidades complexas que o utilizador enxerga como “aplicações” ou “programas”.

Como as pessoas realmente aprendem e praticam programação

Muita gente aprende a programar num modelo muito parecido com o ensino de matemática: começa-se com um pouco de teoria, vê-se um ou dois exemplos resolvidos e, em seguida, uma enxurrada de exercícios. Esse formato incentiva o estudante a tentar resolver os problemas sozinho, insistir na solução e só muito depois considerar pedir ajuda.

Esse espírito de “deixa que eu resolvo sozinho” é positivo até certo ponto, porque estimula autonomia e pensamento crítico. Mas pesquisas mostram que muitos iniciantes ficam presos em problemas simples bem mais tempo do que o necessário, justamente por não saberem o momento de parar, pedir orientação ou procurar recursos adicionais.

Um detalhe psicológico importante é que programadores costumam relatar problemas de forma incompleta. Estudos em psicologia indicam que quando alguém enfrenta um erro ou dificuldade — especialmente se acha que “deveria saber” aquilo — tende a omitir detalhes ao pedir ajuda, com receio de soar inexperiente ou “fraco”. Em programação, isso significa descrever o bug pela metade e, assim, receber menos ajuda do que poderia.

Por isso, pedir suporte a outro programador muitas vezes é visto como último recurso. Questionar um colega pode levar a julgamentos, comentários sarcásticos ou simplesmente à sensação de “estou incomodando”. Esse comportamento aparece tanto em equipes presenciais quanto em comunidades online.

É nesse contexto que plataformas como Stack Overflow ganharam tanta força. Elas permitem que dúvidas sejam feitas (muitas vezes de forma anónima ou semi-anónima), que respostas votadas pela comunidade ganhem destaque e que o conhecimento fique registrado e pesquisável. Em vez de depender de um colega específico, o programador passa a ter uma rede global de apoio.

Outra curiosidade interessante é a tentativa de classificar automaticamente o progresso de um programador durante uma tarefa. Pesquisas em engenharia de software já propuseram modelos que identificam, por exemplo, quatro estados típicos ao analisar o comportamento do desenvolvedor e a interação com o código: programação complexa; fazendo avanços; progresso lento; e completamente emperrado.

Detectar quando alguém está “travado” é crucial para a gestão de projetos. Se um membro da equipa fica demasiado tempo preso no mesmo problema, isso afeta prazos, moral do time e confiança no projeto. O desafio é que nem sempre a própria pessoa percebe (ou admite) que está bloqueada; por isso, técnicas de análise de comportamento, histórico de commits e padrões de edição de código ajudam a identificar esses momentos de estagnação.

As chamadas “barreiras de aprendizagem em programação” também foram catalogadas em detalhe. Pesquisadores identificaram pelo menos seis tipos recorrentes de bloqueios: dificuldade em definir o que o programa deve fazer (barreira de design); saber o objetivo mas não saber quais recursos usar (barreira de seleção); ter as ferramentas, mas não saber combiná-las (coordenação); não saber como usar uma API ou comando específico (uso); achar que sabe usar algo, mas o resultado não bate com a expectativa (compreensão); e não ter acesso fácil à informação necessária para validar o que está acontecendo (informação).

Essas barreiras explicam porque dois programadores com conhecimento parecido podem ter performances tão diferentes. Um deles talvez já saiba identificar rapidamente em qual tipo de bloqueio está e como contorná-lo (consultando documentação, pedindo ajuda, prototipando). Outro pode ficar horas “batendo a cabeça” no mesmo ponto, aumentando a frustração e a sensação de incapacidade.

O que os programadores de facto fazem: navegar, entender, depois escrever

Uma ideia que muita gente tem é que programar é, basicamente, digitar código sem parar. Na prática, pesquisas mostram que algo em torno de 30% do tempo de um desenvolvedor é gasto não a escrever, mas a navegar entre arquivos, ler trechos de código, procurar onde algo está implementado, tentar entender o fluxo e coletar informações relevantes.

Essa atividade “contemplativa” de passear pelo código-fonte envolve leitura atenta, buscas por palavras-chave, comparação entre funções, consultas à documentação e até anotações para manter um modelo mental do sistema. Só depois desse trabalho é que o programador se sente seguro para editar, apagar ou adicionar linhas de código.

Em manutenção de software, esse padrão é ainda mais forte. Trabalhar em código legado — aquele sistema antigo que já passou por muitas mãos — exige entender decisões anteriores, padrões utilizados, dependências externas e pequenos “truques” que foram sendo adicionados ao longo do tempo. A pressa em mexer sem compreender costuma gerar ainda mais bugs.

Várias pesquisas empíricas em engenharia de software analisaram como os desenvolvedores procuram, relacionam e guardam informação enquanto resolvem tarefas de manutenção. Os resultados reforçam que ferramentas que melhoram a navegação (busca avançada, visualização de dependências, links entre tickets de bug e trechos de código) têm impacto direto na produtividade.

Outro ponto curioso está na produtividade de equipas distribuídas. Estudos de colaboração global em software sugerem que, em média, equipas totalmente remotas produzem um pouco menos do que equipas co-localizadas. Um dos motivos é a perda da “conversa de corredor” — aquele comentário rápido no café que resolve uma dúvida em segundos, em vez de trocar dezenas de mensagens assíncronas.

Isso não significa que trabalho remoto seja ineficiente por definição, mas que é preciso compensar a falta de interação espontânea com práticas conscientes: canais de comunicação claros, cultura de documentação, reuniões técnicas focadas e incentivos para que as pessoas realmente compartilhem problemas e soluções.

Manutenção de software: onde vai a maior fatia do esforço

Quando se fala em desenvolvimento de software, muita gente pensa só na fase de criação: análise de requisitos, design da solução, implementação inicial. Porém, estudos clássicos mostram que mais de metade do esforço total de um sistema ao longo da sua vida útil está na manutenção. Ou seja, manter o que já existe consome mais tempo e recursos do que criar a primeira versão.

Em certos contextos, especialmente em grandes organizações, a manutenção pode chegar a representar até 90% de todos os custos de um projeto de software. Isso inclui corrigir bugs, adaptar o sistema a novas leis ou ambientes, melhorar desempenho, atualizar bibliotecas, reforçar segurança e refatorar trechos problemáticos.

Os pesquisadores também classificaram as práticas de manutenção em quatro grandes grupos. A manutenção corretiva trata da solução de erros; a adaptativa ajusta o software a mudanças no ambiente (como novos sistemas operacionais ou integrações); a perfectiva (ou de melhoria) adiciona ou aprimora funcionalidades; e a preventiva trabalha em ajustes que evitam problemas futuros, como limpeza de código ou melhorias de arquitetura.

Ter essa classificação ajuda a medir melhor o que está a acontecer num projeto. Se uma equipa passa a maior parte do tempo em manutenção corretiva, pode ser um sinal de código frágil, testes insuficientes ou requisitos mal definidos. Se há bastante esforço em manutenção preventiva, provavelmente existe uma preocupação maior com a longevidade e a qualidade do sistema.

Essa visão de custos ao longo do tempo também mudou a forma de enxergar o design de software. Estudos que ficaram famosos na década de 1980 mostraram que correções feitas tardiamente, quando a arquitetura já está consolidada e muitos módulos dependem umas das outras, custam muito mais caro do que ajustes feitos logo no início. Isso influenciou o surgimento de processos mais iterativos e preocupados com qualidade desde cedo.

A revisão de código por pares é outro ponto chave ligado à manutenção. Pesquisas de produtividade apontam que ter mais de uma pessoa a analisar o código aumenta substancialmente a taxa de detecção de defeitos — em alguns cenários, até cerca de 60% dos problemas podem ser identificados nessa etapa, antes de chegarem ao utilizador final.

Práticas modernas como pair programming, code review formal e integração contínua foram bastante inspiradas nesses resultados empíricos. Elas partem da ideia de que é mais barato e mais seguro detectar problemas cedo, com olhares diferentes, do que deixar para descobrir tudo em produção e sair “apagando incêndio”.

Hardware, software e a relação entre as duas camadas

Quando falamos de computadores, estamos sempre lidando com dois grandes blocos: hardware (a parte física) e software (os programas e sistemas). Apesar de intimamente ligados, cada um tem funções e características bem distintas.

O hardware é tudo aquilo que podemos tocar ou ver fisicamente: monitor, teclado, rato, placa-mãe, processador, memória, disco rígido, placa de vídeo, placa de som, fonte de alimentação, drive de CD/DVD, entre outros. Esses componentes trabalham juntos para executar as instruções que o software lhes envia.

Costuma-se organizar o hardware em quatro categorias principais. Os dispositivos de entrada (como teclado e rato) são os que enviam dados do utilizador para o computador. Os dispositivos de saída (monitor, colunas) devolvem informações numa forma que possamos perceber. Os componentes internos (placa-mãe, CPU, RAM, etc.) são o “miolo” da máquina. E os dispositivos de armazenamento secundário (como o disco rígido) guardam dados de forma permanente.

Alguns exemplos ajudam a visualizar melhor: o monitor traduz sinais elétricos em imagens; o teclado transforma toques de tecla em códigos que o sistema entende; o processador coordena e executa operações lógicas e aritméticas; a memória RAM guarda temporariamente dados que estão em uso; o disco rígido preserva arquivos e programas mesmo quando o computador é desligado.

Do outro lado, o software é a parte lógica: instruções, programas, sistemas operativos e aplicações que dizem ao hardware o que fazer. Em vez de componentes físicos, o software é composto por código — sequências de instruções armazenadas em ficheiros e interpretadas ou compiladas para binário.

Podemos dividir o software em duas grandes classes. Os softwares de sistema, como Windows ou Linux, fazem a ponte entre o hardware e o utilizador, gerindo recursos, ficheiros, processos, permissões e assim por diante. Já os softwares de aplicação são os programas que usamos no dia a dia, como navegadores, editores de texto, planilhas, leitores de PDF, mensageiros instantâneos, antivírus e ferramentas de acesso remoto.

Programas como Adobe Acrobat Reader, Mozilla Firefox, Skype, TeamViewer ou antivírus como Avast são exemplos clássicos de software de aplicação. Cada um oferece uma funcionalidade específica: ler PDFs, navegar na web, falar por voz ou vídeo, controlar outro computador à distância, proteger o sistema contra malware, entre outros.

A grande diferença prática entre hardware e software está na forma como envelhecem e são mantidos. O hardware pode queimar, desgastar ou ficar fisicamente obsoleto; quando isso acontece, a solução é substituir peças. Já o software, em geral, “envelhece” por ficar desatualizado, inseguro ou incompatível com novas tecnologias, sendo necessário atualizar, corrigir ou até reescrever partes do código.

Em qualquer dispositivo moderno — desde um portátil potente até uma máquina de lavar inteligente — o mesmo princípio se repete: o software define a lógica e os comportamentos; o hardware executa e materializa essas instruções no mundo físico. Sem software, o hardware é inerte; sem hardware, o software é apenas uma sequência abstrata de bits.

Segurança informática: proteger hardware, software e redes

Com a explosão da conectividade e da internet, a segurança informática deixou de ser luxo e passou a ser requisito básico de qualquer sistema. Ela engloba o conjunto de técnicas, práticas e ferramentas que procuram impedir acesso não autorizado, perdas de dados, interceptação de comunicações ou danos a equipamentos.

Uma das dimensões da segurança é a proteção de hardware. Aqui entram dispositivos especializados, como firewalls físicos, appliances de segurança de rede, módulos criptográficos dedicados (HSMs) e servidores proxy, que filtram, monitorizam e controlam o tráfego para evitar ataques. Há também mecanismos de bloqueio físico, como fechaduras de computador e sensores antifurto.

Essa camada de segurança de hardware costuma ser a mais robusta, já que atua muito próxima da infraestrutura e pode isolar ataques antes que cheguem ao sistema operativo ou às aplicações. Em ambientes críticos, é comum combiná-la com políticas rigorosas de acesso físico, vigilância e controlo de dispositivos externos.

Outra frente importantíssima é a segurança de software, voltada para tornar programas mais resistentes a falhas e ataques. Isso inclui desde boas práticas de desenvolvimento (tratamento de erros, validação de entradas, uso correto de bibliotecas) até testes de penetração, correções regulares e atualizações de segurança, incluindo como manter o ADWCleaner atualizado.

Vulnerabilidades de software podem surgir de muitos lados: erros de implementação, falhas de design, gestão inadequada de memória (como estouro de buffer), má gestão de autenticação e autorização, ausência de criptografia adequada e muito mais. Hackers exploram justamente essas brechas, muitas vezes em aplicações expostas à internet.

Como resposta, a área de segurança de software vem ganhando terreno com práticas como revisão de código focada em segurança, integração de testes automáticos, análise estática e dinâmica, e o chamado security by design — incorporar requisitos de segurança desde o início do desenvolvimento, e não só “colar” um antivírus no fim.

A terceira grande vertente é a segurança de rede, cujo objetivo é proteger a troca de dados entre dispositivos e sistemas. As ameaças aqui são variadas: vírus, worms, cavalos de Tróia, spyware, adware, ataques de dia zero, roubo de dados, escutas de tráfego e ataques distribuídos de negação de serviço, entre outros.

Para mitigar esses riscos, é comum combinar múltiplos componentes: firewalls (de software e de hardware), sistemas de deteção e prevenção de intrusão, VPNs (redes privadas virtuais) para acesso remoto seguro, políticas de segmentação de rede e monitorização constante de tráfego suspeito.

Não existe uma “bala de prata” em segurança. Por isso, fala-se tanto em “defesa em profundidade”: vários níveis de proteção se sobrepõem, de forma que, se um falhar, outros possam conter ou, pelo menos, retardar o ataque, dando tempo para resposta e correção.

Como as organizações dependem cada vez mais de sistemas informáticos para tudo, a segurança deixou de ser apenas um requisito técnico e passou a ter impacto direto na reputação, na confiança dos clientes e na continuidade do negócio. Uma falha grave pode significar perda de dados sensíveis, multas, processos judiciais e danos de imagem difíceis de reparar.

Juntando todas essas peças — curiosidades históricas, forma como programadores pensam e trabalham, custos de manutenção, relação entre hardware e software e camadas de segurança — dá para perceber que o mundo do desenvolvimento de software é muito mais vasto e complexo do que “só escrever código”. É um campo que mistura ciência, engenharia, psicologia, gestão, criatividade e, claro, um bocado de teimosia saudável para continuar aprendendo e melhorando sistemas que usamos o tempo todo, quase sempre sem perceber o trabalho gigante que existe por trás.