- A API de Gemini conecta aplicativos, sites e sistemas ao modelo de IA generativa do Google sem exigir infraestrutura própria de IA.

- O nível gratuito oferece acesso a modelos como Gemini Pro, Flash e Nano Banana, com limites de requisições e tokens por projeto.

- É possível integrar Gemini em apps Android via Firebase AI Logic, além de migrar para Vertex AI ou até rodar modelos em hardware próprio certificado.

- Boas práticas de segurança, gestão de chaves e entendimento das limitações de cada modelo são essenciais para usar a API com eficiência.

A API de Gemini é a porta de entrada para usar a inteligência artificial generativa do Google dentro de apps, sites, bots, fluxos de automação e praticamente qualquer tipo de software conectado à internet. Em vez de falar com a IA só pelo chatbot oficial, você passa a conversar com o modelo Gemini diretamente a partir do seu próprio projeto, por código.

Essa conexão acontece por meio de uma chave de API e de endpoints específicos, que permitem enviar textos, imagens, áudio e até vídeo para os servidores do Google, receber respostas geradas pela IA e integrá‑las à experiência do usuário. Tudo isso com um nível gratuito generoso para experimentar, limites claros de uso e a possibilidade de escalar depois para planos pagos ou infraestruturas mais robustas, como Vertex AI ou mesmo hardware próprio certificado.

O que é a API de Gemini e por que ela é tão importante

Gemini é o nome do modelo de IA generativa do Google e também do assistente/chat que usa esse modelo para responder às suas perguntas. Por baixo daquele chat bonitinho existe um motor poderoso, capaz de entender linguagem natural, analisar imagens, lidar com áudio e vídeo e gerar conteúdo de vários tipos em cima dessa entrada.

A API de Gemini é a interface de programação que permite que esse motor seja usado fora dos produtos oficiais do Google. Em termos simples, é um conjunto de endpoints e regras para que um software (seja um app Android, um site, um bot no WhatsApp ou um sistema interno) consiga mandar dados para o modelo Gemini e receber de volta o resultado do processamento.

Você pode pensar na API como uma ponte entre o seu aplicativo e os servidores de IA do Google. O código da sua aplicação não precisa carregar o modelo gigante de IA, que ocuparia muitos gigabytes e exigiria GPUs caríssimas. Em vez disso, ele só envia requisições pela internet, a IA processa tudo na infraestrutura do Google e devolve a resposta pronta.

Esse mesmo mecanismo é o que permite a qualquer desenvolvedor “encaixar” Gemini em fluxos já existentes: um CRM que responde dúvidas de clientes, um sistema corporativo que gera relatórios a partir de PDFs, um chatbot de suporte, um app de estudo que corrige redações, um editor que cria resumos de vídeos e assim por diante.

A API gratuita de Gemini funciona por meio de uma chave (API key) que identifica o seu projeto e controla quanto você está usando o serviço. Essa chave é como a “senha do portão” que libera o acesso aos modelos Gemini; por isso, precisa ser guardada com cuidado e nunca deve ser exposta em código público.

Para que serve a API de Gemini na prática

Na prática, a API de Gemini serve para você integrar inteligência artificial generativa em qualquer fluxo digital, sem precisar ser um expert em machine learning nem ter infraestrutura própria de IA. O modelo já vem treinado e escalado pelo Google; você só cuida das chamadas e da lógica de negócio.

Um uso clássico é a criação de chatbots e assistentes inteligentes, que podem conversar com usuários em linguagem natural, manter histórico de contexto em vários turnos e personalizar respostas com base em dados específicos do seu sistema. A API oferece recursos de chat multi‑turno que permitem continuar diálogos sem perder o fio da conversa.

Outro uso forte é o processamento de documentos e conteúdos multimídia. Com a API, você consegue enviar textos longos, PDFs, imagens, áudios e vídeos como entrada, e pedir para o modelo resumir, extrair informações, explicar conceitos, responder perguntas sobre o conteúdo ou reescrever em outro formato.

A API de Gemini também é muito utilizada para geração de código e automação de tarefas técnicas. Você pode, por exemplo, pedir que o modelo escreva trechos de código, explique funções, sugira testes, gere scripts de automação ou valide entradas de usuários em formulários complexos.

Na parte de criatividade e marketing, a API permite gerar textos, roteiros, descrições de produtos, posts para redes sociais, e-mails e muito mais, ajustando o tom de voz e o estilo de acordo com o seu público. Com o suporte multimodal, dá para combinar isso com imagens geradas por IA, como veremos adiante.

Modelos disponíveis: Gemini Pro, Flash, Nano Banana e Veo

A API de Gemini não expõe um único modelo, e sim uma família de modelos especializados, com tamanhos, capacidades e custos diferentes. Isso permite que você escolha a opção mais adequada para cada caso de uso, equilibrando qualidade, velocidade e preço.

No nível gratuito, você costuma ter acesso a versões como Gemini 2.5 Pro, Gemini 3 Flash e modelos de imagem como Nano Banana, além de variantes anteriores, como Gemini 2.5 Flash e Gemini 2.5 Flash Lite. As combinações exatas podem mudar com o tempo, mas a ideia é sempre oferecer um conjunto básico robusto para experimentação.

Alguns modelos mais avançados ou especializados podem não estar incluídos no plano gratuito, como Gemini 3.1 Pro, versões mais recentes de Nano Banana (por exemplo, Nano Banana 2) ou modelos de vídeo como Veo. Nesses casos, o acesso acontece via níveis pagos ou diretamente por ferramentas como Google AI Studio e Vertex AI.

Para geração e edição de imagens, um dos destaques é o modelo Gemini 2.5 Flash Image, conhecido como Nano Banana. Ele é capaz de criar imagens a partir de descrições textuais, editar imagens existentes com base em instruções em linguagem natural e manter o contexto em interações de vários turnos voltadas para edição visual.

Já para quem precisa trabalhar com vídeo, o Google oferece o modelo Veo, focado em geração de vídeo via IA. Esse tipo de modelo, porém, tende a ficar fora do nível gratuito e é pensado mais para usos profissionais com cobrança baseada em consumo.

Limites da API gratuita de Gemini: velocidade, tokens e modelos

A API gratuita de Gemini é ótima para começar, mas vem com limites bem definidos para garantir que o serviço continue estável para todo mundo. Esses limites são essenciais para planejar o uso em produção e saber a hora de migrar para um plano pago.

Os principais limites são definidos em termos de requisições e tokens: a quantidade de chamadas por minuto (RPM), o volume de tokens de entrada processados por minuto (TPM) e o total de requisições por dia (RPD). Se você estourar qualquer um desses números, a API devolve um erro específico de limite de frequência.

Um exemplo citado na documentação é o modelo Gemini 2.5 Pro no nível gratuito, que pode ter algo como 5 chamadas por minuto e 100 por dia, dependendo da configuração de projeto e da região. Outros modelos vão ter limites diferentes, mas sempre seguindo essa lógica de cotas.

É importante notar que esses limites são aplicados por projeto, e não por chave individual. Ou seja, se você criar várias API keys dentro do mesmo projeto no Google Cloud ou AI Studio, todas elas vão compartilhar os mesmos limites de uso.

Além disso, há restrições ligadas à privacidade, ao tipo de dados e às janelas de contexto. Alguns modelos gratuitos podem ter janelas de contexto menores (quantidade de tokens que conseguem analisar de uma vez) ou políticas mais rígidas de retenção de dados, o que impacta como você estrutura prompts e históricos de conversa.

Como obter uma API key gratuita de Gemini

Para começar a usar a API de Gemini, o primeiro passo é gerar uma chave de API, que é um código alfanumérico usado para autenticar suas requisições e associar o consumo ao seu projeto.

A forma mais simples de conseguir essa chave é pelo Google AI Studio, o ambiente web do Google voltado para experimentar com Gemini, testar prompts e gerar trechos de código prontos para integrar em aplicativos.

Depois de entrar no Google AI Studio com a sua conta Google, procure na lateral inferior esquerda a opção “Get API key” ou similar. Esse atalho leva você diretamente para a área de gerenciamento de chaves de API associadas aos seus projetos.

Na página de chaves, escolha a opção de criar uma nova API key. Normalmente, você precisa vincular essa chave a um projeto específico, que pode ser criado na hora. Esse projeto é o contêiner lógico que agrupa limites de uso, configurações de segurança e faturamento (mesmo que você só use o nível gratuito).

Uma vez gerada, a chave aparece na lista de API keys do seu projeto, com data de criação e nível de cota. Em algumas interfaces, o valor completo da chave não fica visível depois, justamente por segurança, então é importante guardá-la de forma segura, como você faria com senhas sensíveis.

Boas práticas de segurança com a chave de API

A sua API key de Gemini é sensível e assume o papel de identidade do seu projeto diante dos servidores do Google. Se alguém obtiver essa chave, poderá consumir a sua cota, gerar custos e até violar políticas usando os seus recursos.

Nunca deixe a chave exposta em código cliente, como JavaScript rodando no navegador ou apps móveis desprotegidos. O ideal é que as chamadas à API de Gemini aconteçam em um backend sob seu controle, em que a chave fique armazenada em variáveis de ambiente ou sistemas de gerenciamento de segredos.

Outro ponto é monitorar o uso da API para detectar comportamentos estranhos, como um volume inesperado de requisições. Os dashboards do Google ajudam você a enxergar esse tipo de anomalia e tomar providências rápidas, como revogar uma chave vazada.

Se você suspeitar que a API key foi comprometida, revogue-a imediatamente e gere uma nova, atualizando a configuração dos serviços que a utilizam. Não há limite rígido para rotacionar chaves; é um procedimento de segurança recomendado.

Por fim, mantenha políticas internas claras sobre quem pode acessar e gerenciar as chaves. Em times maiores, é comum aplicar o princípio de menor privilégio, limitando o acesso apenas a quem realmente precisa lidar com a autenticação da API.

Usando a API de Gemini em apps Android com Firebase AI Logic

Um dos jeitos mais práticos de integrar a API de Gemini em apps Android é por meio do Firebase AI Logic, que fornece SDKs, configuração simplificada e um caminho suave de prototipagem até escala em produção.

Com o Firebase AI Logic, você consegue chamar modelos como Gemini Pro e Gemini Flash diretamente do aplicativo, aproveitando um nível gratuito generoso e a possibilidade de migrar depois para um plano pago sem ter que reescrever toda a lógica.

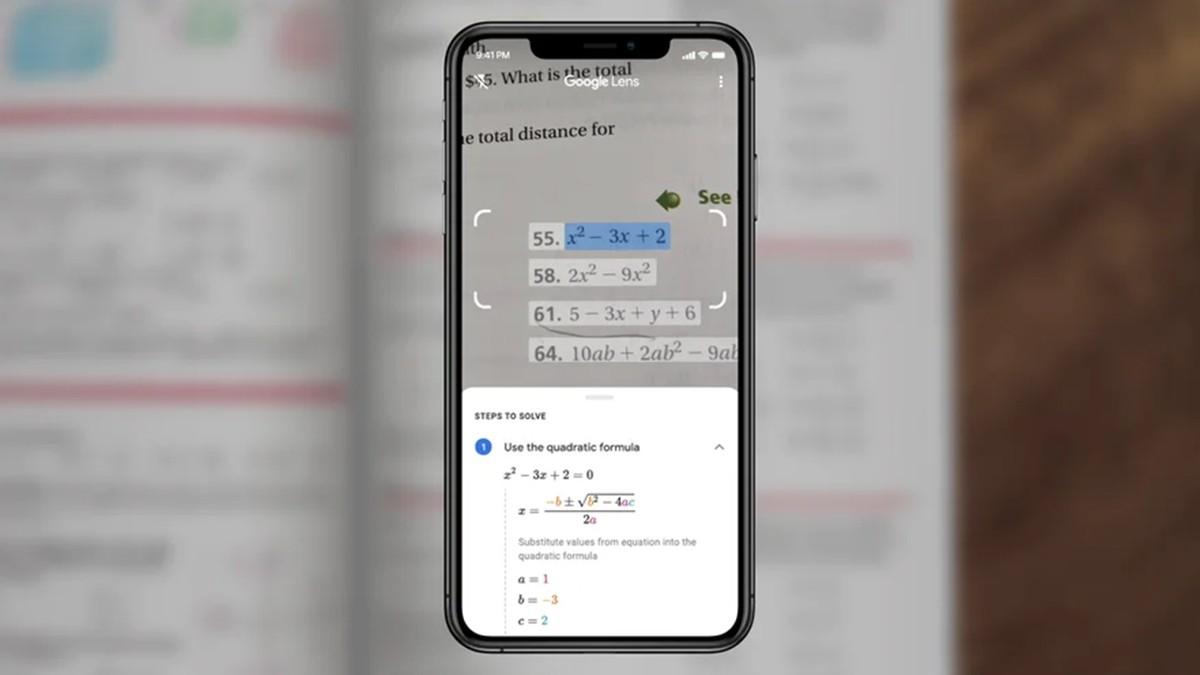

Antes de chamar a API de dentro do app, é recomendável experimentar instruções (prompts) no Google AI Studio. Esse ambiente funciona como um IDE de prompts, em que você pode testar diferentes formulações, exemplos e formatos de saída até encontrar o que melhor atende ao seu caso de uso.

Quando estiver satisfeito com o prompt, o AI Studio permite gerar fragmentos de código prontos para várias linguagens e plataformas. Basta clicar no botão com o símbolo <> para ver os exemplos e adaptá-los ao seu projeto Android.

No lado do Firebase, você precisa criar ou escolher um projeto, conectar o seu app Android e adicionar a dependência correta do SDK no Gradle. Depois, é questão de inicializar um objeto de modelo generativo (por exemplo, GenerativeModel), informando o nome do modelo Gemini que você quer usar.

Interagindo com a API: texto, multimodal, chat e imagens

Uma vez configurado o acesso, você pode interagir com a API de Gemini de formas bem variadas, indo além do simples “pergunta e resposta” em texto.

Para gerar texto puro, o fluxo comum é chamar um método como generateContent(), passando sua instrução de entrada (prompt). O modelo devolve uma resposta textual que você exibe, processa ou usa para alimentar um outro sistema.

Se o seu caso de uso envolve várias mídias, você pode combinar texto com imagens, áudio, vídeo e documentos. Na chamada à API, esse conteúdo é enviado como dados intercalados (por exemplo, um bitmap com tipo de conteúdo image, ou arquivos com inlineData e MIME types corretos, como application/pdf ou text/plain).

Para experiências de conversa contínua, a API oferece recursos de chat de múltiplos turnos. Você pode iniciar um chat com startChat(), opcionalmente fornecendo um histórico de mensagens, e depois seguir enviando mensagens com sendMessage(), mantendo o contexto ao longo do diálogo.

Na parte visual, a API de Gemini suporta geração e edição de imagens via modelos como Gemini 2.5 Flash Image (Nano Banana). Você pode mandar apenas texto para criar imagens do zero ou enviar uma combinação de texto e imagens para aplicar edições contextuais, como alterar estilo, adicionar elementos ou ajustar cores.

Há também um modo conversacional para edição de imagens, em que você mantém um chat e vai refinando a arte a cada novo pedido. Assim, não é necessário reenviar a imagem original a cada solicitação; o modelo preserva o estado do que já foi gerado ou modificado.

Limitações e comportamento da geração de imagens

A geração de imagens com Gemini traz algumas considerações importantes de formato, tipos de entrada, idiomas e possíveis falhas. Entender essas nuances ajuda a ajustar seus prompts e expectativas.

As imagens geradas são, em geral, entregues no formato PNG, com dimensão máxima em torno de 1024 pixels. Isso significa que não é uma solução para impressão de altíssima resolução, mas atende bem a grande parte dos usos digitais.

O modelo de imagem não aceita áudio ou vídeo como entrada para gerar imagens. Ele trabalha com prompts em texto e, opcionalmente, imagens estáticas já existentes, além de documentos suportados no contexto multimodal geral.

Os resultados costumam ser melhores em certos idiomas, como inglês (en), espanhol (es-mx), japonês (ja-jp), chinês simplificado (zh-cn) e hindi (hi-in). Em outros idiomas, como o português, a qualidade ainda pode ser muito boa, mas vale testar e ajustar a forma de escrever os prompts.

Nem sempre a API consegue ativar a geração de imagem; em alguns casos, você recebe apenas texto como resposta. Quando isso acontecer, uma dica é deixar claro no prompt que você quer imagens, com instruções como “gere uma imagem”, “forneça ilustrações ao longo da resposta” ou “atualize a imagem de acordo com as alterações”.

Também pode ocorrer de o modelo interromper a resposta no meio ou gerar texto embutido na imagem em contextos em que isso não era desejado. Nesses cenários, geralmente compensa reformular o prompt, tentar novamente ou separar melhor o que deve ser texto e o que deve ser imagem.

Do protótipo à produção: Google AI Studio, Vertex AI e infraestrutura própria

O ecossistema da API de Gemini foi pensado para acompanhar o ciclo de vida de um projeto, desde a fase de experimentação até implementações de grande escala em ambientes críticos.

No começo, o Google AI Studio é o ponto de partida ideal para testar ideias, brincar com prompts, avaliar diferentes modelos e gerar exemplos de código. Ele se integra bem à API de Gemini Developer e ao Firebase AI Logic, simplificando a etapa de prototipagem.

Quando o aplicativo amadurece e precisa de recursos mais avançados, governança e escalabilidade corporativa, o caminho natural é migrar para Vertex AI no Google Cloud. Lá você consegue integrar Gemini com uma série de serviços de dados, monitoramento, segurança e orquestração de modelos.

Para organizações com requisitos rígidos de localização de dados e soberania, existe ainda a possibilidade de usar Gemini em ambientes de Google Distributed Cloud connected, rodando os modelos em hardware certificado dentro dos próprios datacenters do cliente.

Nesse cenário de Distributed Cloud connected, os modelos de Gemini são executados em máquinas virtuais confidenciais (CVMs), com atestação remota baseada em Intel SGX, garantindo que o ambiente de execução é íntegro e protegido contra interferências externas.

Gemini em Google Distributed Cloud connected e hardware certificado

Quando falamos em Gemini na API conectada do Google Distributed Cloud (GDC connected), estamos falando de uma solução de software “chave na mão”, em que o cliente instala hardware certificado pelo Google em sua própria rede local e roda modelos de Gemini ali mesmo.

Esse hardware segue especificações bem detalhadas, geralmente baseadas em servidores robustos como chassi Dell XE9680, com múltiplos processadores Intel Xeon de muitos núcleos, grandes quantidades de memória DDR5 e conjuntos de GPUs NVIDIA de classe H200, além de armazenamento NVMe redundante e adaptadores de rede de alta velocidade.

O armazenamento costuma ser dividido entre discos para o sistema operacional, partições reservadas para funções internas do sistema e volumes dedicados aos dados das máquinas virtuais confidenciais que atendem aos endpoints de API locais de Gemini.

A conectividade exige múltiplas placas de rede, com portas de 100 GbE para tráfego pesado e interfaces adicionais para gerenciamento e controle, além de fontes de alimentação redundantes com certificações de eficiência elevadas.

Esse arranjo permite que uma organização hospede modelos como Gemini 2.5 Flash 128k localmente, usando IDs públicos específicos (por exemplo, gemini-2.5-flash-ggc) e mantendo certo controle físico sobre a infraestrutura, algo importante para setores regulados.

Segurança avançada: máquinas virtuais confidenciais e atestação remota

Um ponto central nessa abordagem on‑premises é o uso de máquinas virtuais confidenciais (CVMs), que formam um ambiente de execução isolado e criptografado para os modelos de Gemini dentro do cluster de Google Distributed Cloud connected.

Para garantir que essas CVMs continuam íntegras ao longo do tempo, é usada atestação remota. Basicamente, existe um “batimento” constante entre a implementação local e os serviços do Google, verificando se o software e o hardware permanecem em um estado confiável.

Essa certificação remota se apoia em serviços de atestação do Intel Software Guard Extensions (Intel SGX). O cliente precisa ter uma assinatura ativa desses serviços e fornecer as chaves de API correspondentes ao Google durante o processo de pedido e configuração.

Se o batimento de atestação ficar interrompido por mais de cerca de 30 minutos, as máquinas virtuais confidenciais podem ser desligadas até que a conectividade e a certificação sejam restabelecidas, como medida de segurança.

Esse modelo de operação é voltado para clientes corporativos que exigem níveis máximos de governança, auditoria e conformidade. Para a maioria dos desenvolvedores, a API de Gemini via Google Cloud e AI Studio já é mais do que suficiente, mas é interessante saber que existe esse caminho para casos extremos.

Passos gerais de uma implantação de Gemini em GDC connected

Implantar Gemini na API conectada de Google Distributed Cloud envolve uma sequência de etapas bem definidas, que vão desde a compra do hardware até a interação final com endpoints locais.

Primeiro, a organização precisa adquirir e instalar o hardware certificado exatamente de acordo com as especificações, seguindo as orientações oficiais de infraestrutura, energia, resfriamento e conectividade.

Em seguida, é necessário cumprir todos os requisitos de instalação, o que inclui fornecer ao Google rótulos de serviço, informações de identificação das máquinas, dados das chaves de atestação SGX e detalhes da rede.

Depois disso, o cliente faz o pedido formal de Gemini na API conectada, para que o Google possa provisionar o ambiente de software, configurar a gestão remota e ativar o mecanismo de atestação nas CVMs que vão hospedar os modelos.

Um técnico do Google normalmente visita o local para instalar e configurar o software da API conectada no hardware certificado, garantindo que tudo esteja operando dentro dos padrões exigidos.

Na camada de Google Cloud, é preciso habilitar as APIs necessárias, configurar uma conta de faturamento para o projeto de destino, atribuir papéis (roles) aos administradores e consumidores da API e, por fim, criar e publicar os endpoints de API conectados.

Depois que os endpoints estão ativos, os desenvolvedores podem interagir com o Gemini implementado localmente de forma muito parecida com a API em nuvem, apenas apontando para os novos endpoints internos conforme descrito na documentação específica.

No fim das contas, a API de Gemini funciona como um eixo central que conecta modelos de IA avançados a uma grande variedade de cenários, desde um protótipo simples feito em AI Studio até um cluster on‑premises com hardware certificado, passando por apps Android com Firebase, backends em nuvem e integrações com sistemas corporativos complexos. Entender como a API, as chaves, os modelos, os limites de uso e as opções de infraestrutura se encaixam é o caminho para tirar o máximo proveito da IA generativa do Google em projetos de qualquer porte.